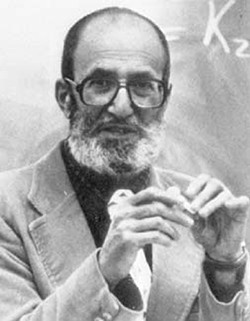

Paul Halmos (1916–2006)

Né à Budapest en mars 1916, Paul Halmos rejoint son père médecin à Chicago à l'âge de 13 ans, part étudier la philosophie à l'université de l'Illinois à 16 ans, avant de s'orienter vers les mathématiques. Après avoir obtenu en 1938 son doctorat sur les invariants dans les processus stochastiques, sous la direction du grand probabiliste Joseph Leo Doob (1910–2004), l'un des fondateurs de la théorie des martingales, il assiste son compatriote John von Neumann à Princeton pendant deux ans. De ce géant, Halmos dira que « sa rapidité, ainsi que sa profondeur, sa perspicacité, son inspiration [l]'ont stimulé ». Il lui doit d'avoir rédigé, à partir de ses cours, son premier livre Espaces vectoriels de dimension finie, qui l'installe de facto comme un remarquable écrivain des mathématiques. Clarté, concision et originalité sont les principales caractéristiques de cet auteur, qui fut aussi professeur, éditeur et conférencier de talent. Outre ses ouvrages de pédagogie mathématique en théorie des ensembles et analyse fonctionnelle, il publie, à l'instar de deux autres Hongrois, György Pólya (1887–1985) et Gábor Szegö (1895–1985), des livres de problèmes pour tous niveaux.

Né à Budapest en mars 1916, Paul Halmos rejoint son père médecin à Chicago à l'âge de 13 ans, part étudier la philosophie à l'université de l'Illinois à 16 ans, avant de s'orienter vers les mathématiques. Après avoir obtenu en 1938 son doctorat sur les invariants dans les processus stochastiques, sous la direction du grand probabiliste Joseph Leo Doob (1910–2004), l'un des fondateurs de la théorie des martingales, il assiste son compatriote John von Neumann à Princeton pendant deux ans. De ce géant, Halmos dira que « sa rapidité, ainsi que sa profondeur, sa perspicacité, son inspiration [l]'ont stimulé ». Il lui doit d'avoir rédigé, à partir de ses cours, son premier livre Espaces vectoriels de dimension finie, qui l'installe de facto comme un remarquable écrivain des mathématiques. Clarté, concision et originalité sont les principales caractéristiques de cet auteur, qui fut aussi professeur, éditeur et conférencier de talent. Outre ses ouvrages de pédagogie mathématique en théorie des ensembles et analyse fonctionnelle, il publie, à l'instar de deux autres Hongrois, György Pólya (1887–1985) et Gábor Szegö (1895–1985), des livres de problèmes pour tous niveaux.

Pour Halmos, les mathématiciens ne sont pas de simples calculateurs, mais des artistes, car les mathématiques sont un art de création. Ainsi, faire des mathématiques ne se limite pas à les lire, mais à se confronter avec ! Posez vos propres questions, trouvez vos propres exemples, établissez vos démonstrations personnelles. Cette hypothèse est-elle nécessaire ? L'inverse est-il vrai ? Qu'arrive-t-il dans les cas classiques ? Et dans les cas dégénérés ? Où la preuve utilise-t-elle l'hypothèse ?

John Conway attribue à Halmos la paternité de l'abréviation iff pour if and only if, équivalent anglo-saxon de notre ssi pour si et seulement si. On appelle aussi halmos le symbole de fin de démonstration.

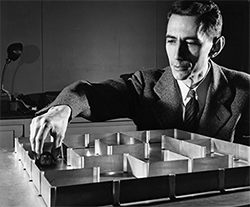

Claude Shannon, le créateur de la théorie de l'information

La Seconde Guerre Mondiale commence quand Claude Shannon finit ses études de mathématiques et d'ingénierie électrique. En rentrant aux laboratoires Bell, il est appelé à s'occuper de questions militaires. La première concerne la prévision des trajectoires d'avions et de missiles, et demande donc des résolutions d'équations différentielles. La seconde concerne le secret des conférences transatlantiques entre les Alliés, et donc la cryptographie, une autre discipline gourmande en calculs.

La Seconde Guerre Mondiale commence quand Claude Shannon finit ses études de mathématiques et d'ingénierie électrique. En rentrant aux laboratoires Bell, il est appelé à s'occuper de questions militaires. La première concerne la prévision des trajectoires d'avions et de missiles, et demande donc des résolutions d'équations différentielles. La seconde concerne le secret des conférences transatlantiques entre les Alliés, et donc la cryptographie, une autre discipline gourmande en calculs.

La théorie de l'information naît au sortir de la guerre, en 1948, avec un article dans lequel Shannon montre comment la notion d'information peut être quantifiée et unifiée sous forme binaire. Il emploie ainsi pour la première fois le terme de bit, qui vient de l'anglais binary digit, dans le sens de « particule élémentaire d'information ».

Roger Apéry (1916–1994), un mathématicien rebelle

(3) défini comme la somme des inverses des cubes des nombres entiers.

(3) défini comme la somme des inverses des cubes des nombres entiers.

Roger Apéry fut aussi un militant de gauche convaincu, souvent téméraire et même rebelle. Il s'oppose pourtant farouchement au mouvement de Mai 1968. Atteint de la maladie de Parkinson, il s'éteint à Caen en 1994.

Lire la suite gratuitement