Le carré d'un nombre réel est toujours positif, et n'est nul que si le nombre lui-même est nul. Quoi de plus anodin ? Si l'on ajoute à ce résultat trivial l'identité remarquable donnant le carré d'une somme, c'est-à-dire (a + b)2 = a2 + 2 ab + b2, on peut déjà traiter un bon nombre de questions d'optimisation. Donnons l'idée de base sur l'exemple de la maximisation du produit de deux nombres quand leur somme est donnée. Pour traiter cette question, notons 2a la somme donnée, x et y les deux nombres. Ils vérifient x + y = 2a, ce qui permet d'écrire y en fonction de x, et donc le produit xy sous la forme 2ax – x2. L'identité remarquable rappelée ci-dessus invite à introduire le carré (x – a)2. On obtient xy = a2 – (x – a)2. Comme le carré (x – a)2 est toujours positif, et nul seulement si x = a, on en déduit que le maximum de xy est égal à a2 et qu'il n'est atteint que si x et y sont égaux.

.jpg) La même idée fonctionne pour trouver le minimum de la somme de deux nombres positifs quand leur produit est donné. Pour cela, il suffit d'écrire le produit et les deux nombres comme des carrés (de nombres positifs) : a2, x2 et y2. L'égalité x2y2 = a2 implique xy = a. En utilisant l'identité remarquable, la somme des deux nombres s'écrit x2 + y2 = (x – y)2 + 2xy, soit x2 + y2 = (x – y)2 + 2a. Le minimum de la somme est donc égal à 2a, et il n'est atteint que si x et y sont égaux.

La même idée fonctionne pour trouver le minimum de la somme de deux nombres positifs quand leur produit est donné. Pour cela, il suffit d'écrire le produit et les deux nombres comme des carrés (de nombres positifs) : a2, x2 et y2. L'égalité x2y2 = a2 implique xy = a. En utilisant l'identité remarquable, la somme des deux nombres s'écrit x2 + y2 = (x – y)2 + 2xy, soit x2 + y2 = (x – y)2 + 2a. Le minimum de la somme est donc égal à 2a, et il n'est atteint que si x et y sont égaux.

Ce résultat permet de trouver le minimum sur ]0, +∞[ de la fonction f définie par :

En effet, f (x) est alors égal à la somme x + y, où xy = a2 si l'on pose :

Le minimum est donc égal à 2a (si a > 0), ce que l'on peut retrouver sans problème par le calcul des variations de f. En effet, l'étude du signe de la dérivée d'une fonction permet de déterminer ses variations, et donc ses extrema. Dans le cas de la fonction f , la dérivée est égale à :

qui est négatif sur ]0, a] et positif ensuite. La fonction décroît de 0 à a puis croît ensuite. Elle admet donc un minimum en a, ce minimum vaut f (a) = 2a.

L'inégalité arithmético-géométrique

De la même manière, la méthode permet de démontrer l'inégalité entre la moyenne arithmétique

avec égalité si, et seulement si, a et b sont égaux. Par récurrence, cette inégalité se généralise aux moyennes arithmétiques et géométriques d'un nombre quelconque de nombres positifs a1, a2… an : on obtient

avec égalité si, et seulement si, tous les ai sont égaux. Augustin Cauchy (1789–1857) en a donné une démonstration merveilleuse (voir en encadré).

L'inégalité arithmético-géométrique permet de trouver des maxima quand des sommes ou des produits de termes sont constants. Deux exemples vont nous permettre d'expliciter ce point.

Déterminons le minimum sur ]0, +∞[2 de la fonction g définie par

En appliquant l'inégalité aux trois nombres 2x, 4y et

ce qui se produit si, et seulement si, x = 1 et y = 1 / 2.

Le minimum de g est donc égal à 6, il est atteint pour x = 1 et y = 1 / 2.

De même, déterminons le maximum sur ]0, +∞[2 de la fonction h définie par h(x,y) = xy (3-x-y).

On peut supposer 3–x–y ≥ 0 puisque sinon h < 0 ne correspond pas à un maximum.

En appliquant l'inégalité aux trois nombres positifs x, y et 3–x–y, on arrive à

L'inégalité de Cauchy–Schwarz

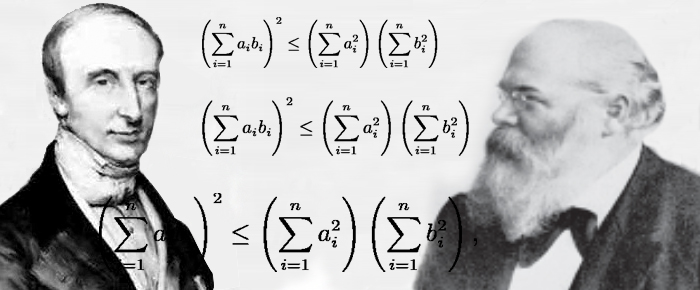

Une autre inégalité célèbre, souvent présentée dans un cadre géométrique, est due à Cauchy mais porte également le nom de Hermann Schwarz (1843–1921), qui l'a étendue à un cadre bien plus général. Si a1, a2… an et b1, b2… bn sont des nombres réels, alors :

(a1b1 + a2b2 + … + anbn)2 ≤ (a12 + a22 + … + an2)(b12 + b22 + … + bn2).

Le cas d'égalité correspond au cas où les ai et les bj sont proportionnels, c'est-à-dire si soit les ai sont tous nuls, soit il existe un coefficient

La démonstration la plus élégante de cette inégalité utilise le fait que le trinôme du second degré T(x) somme des termes (aix + bi)2 ne peut avoir deux zéros distincts (puisqu'il est toujours positif), ce qui se caractérise par le signe de son discriminant et fournit l'inégalité voulue (comme proposé en encadré).

L'inégalité de Cauchy-Schwarz permet de trouver des extrema quand des sommes de carrés sont constantes. Par exemple, déterminons les extrema de 2x + 3y + 6z si x2 + y2 + z2 = 1. En utilisant les nombres 2, 3, 6 et x, y, z, l'inégalité s'écrit (2x + 3y + 6z)2 ≤ 49, avec égalité si, et seulement si, x, y et z sont proportionnels à 2, 3, 6, c'est-à-dire s'il existe